Mike Sharples: “Tenemos que ayudar a los estudiantes con la tecnología, no contra la tecnología”

Mike Sharples: “Tenemos que ayudar a los estudiantes con la tecnología, no contra la tecnología”

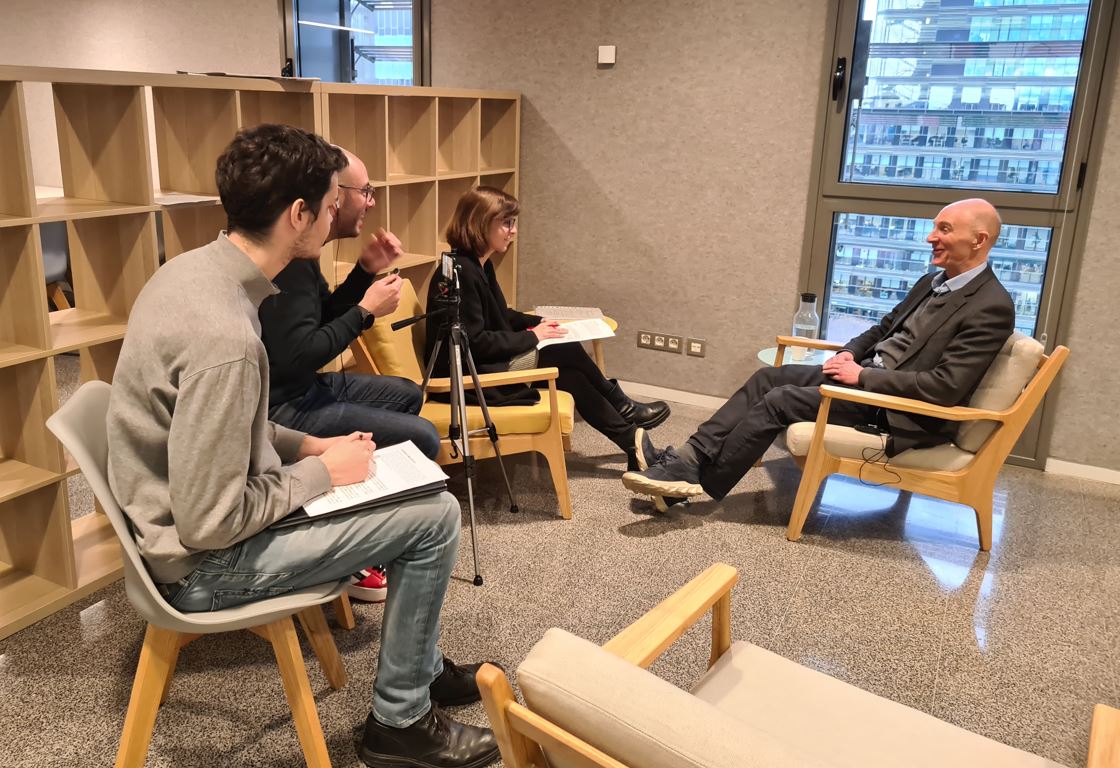

Mike Sharples es uno de los mayores expertos del mundo en las aplicaciones de la tecnología en el mundo educativo, también en cuanto a las herramientas desarrolladas con la inteligencia artificial. Sharples, profesor emérito de Tecnología Educativa en el Reino Unido, pronunció el pasado 24 de enero la conferencia “Pasado, presente y futuro del plagio: implicaciones por la evaluación” en el marco de la última sesión del ciclo “Investigación EDvolució”, celebrada en el auditorio del campus del Poblenou de la UPF.

Mike Sharples es profesor emérito de Tecnología Educativa en el Instituto de Tecnología Educativa de la Universidad Abierta del Reino Unido. Es autor de más de 300 libros y artículos de las áreas de tecnología educativa, educación científica, diseño de tecnologías personales centradas en el ser humano, inteligencia artificial y ciencia cognitiva. Entre sus campos de investigación, también está la investigación sobre nuevas tecnologías y los entornos para el aprendizaje.

También es autor de una serie de informes titulada Pedagogía innovadora y el año pasado publicó el libro Máquinas de historias: cómo los ordenadores se han convertido en escritores creativos, junto con Rafael Pérez, en el que se basa su reciente artículo “Automated Essay Writing: An AIED Opinion“.

En el marco del debate social creciente en el entorno de las implicaciones de la inteligencia artificial, también en el ámbito educativo y universitario, Sharples participó el pasado martes 24 de enero en la sesión del ciclo “Investigación EDvolució” titulada “La evolución del plagio y el rol de la inteligencia artificial: tiempo de repensar la evaluación”. Durante la sesión, celebrada en el auditorio del campus del Poblenou, pronunció la conferencia “Pasado, presente y futuro del plagio: implicaciones por la evaluación”. Posteriormente, tuvimos la oportunidad de conversar un rato con él.

El plagio siempre ha existido ¿Pero aplicaciones de inteligencia artificial (IA) como ChatGPT podrían ser un punto de inflexión en este sentido?

Sí, el plagio ha sido un problema durante siglos, tanto el plagio académico como el plagio estudiantil, pero solo se ha puesto de relevo durante las últimas semanas, a partir de la nueva tecnología de la IA, en particular del ChatGPT. Básicamente, lo que hace el ChatGPT es democratizar el fraude.

Cualquier estudiante podrá crear un ensayo en unos minutos, tan solo le tendrá que dar un título y una introducción y entonces se generará uno automáticamente. Esto representa un gran desafío y es muy perturbador para la educación, pero también representa grandes oportunidades para apoyar al aprendizaje porque es una herramienta potente en relación al lenguaje.

Así pues, hace falta que los investigadores y expertos destinen más esfuerzos a distinguir los textos producidos por humanos o por aplicaciones de inteligencia artificial?

Una de las cosas que ya hemos determinado es que es casi imposible saber si un ensayo ha sido escrito por un estudiante o por una máquina, porque estos sistemas de inteligencia artificial no copian fragmentos de texto. Lo que hacen es buscar millones y millones de palabras, básicamente en Internet, y después generan un nuevo texto con el estilo de los estudiantes o de los académicos. Son muy potentes y crean un lenguaje muy plausible que es único.

Cuando se esté desarrollando una herramienta para distinguir textos producidos por un humano y por una máquina, también se puede estar haciendo un nuevo desarrollo de inteligencia artificial que haga más difícil la detección de esta diferencia. Así pues, no podremos saber si un texto ha sido escrito por un estudiante o por una máquina. Creo que, como cualquier nueva tecnología, genera problemas, pero creo que también se tienen que analizar los aspectos positivos.

¿Cuáles considera que pueden ser los potenciales positivos de la inteligencia artificial en el ámbito educativo?

Creo que hay muchos. En primer lugar, la tecnología puede hacerse cargo de algunos de los aspectos de nivel menor como la ortografía o el estilo de expresión, de forma que exista la posibilidad de centrarse más en los aspectos de nivel superior como la argumentación o garantizar que técnicamente todo sea correcto en cuanto a la investigación. Un gran problema de estos sistemas es que las máquinas pueden producir textos muy plausibles y muy seductores que parecen haber sido escritos por un académico o un estudiante. Pero, cuando se miran de más cerca, hay errores, por ejemplo inventa referencias, porque es una máquina de lenguaje, no es una base de datos. Por lo tanto, hay muchas posibilidades y una de las posibilidades es que los estudiantes realicen ciertos borradores utilizando la inteligencia artificial y entonces hagamos que critiquen aquello que no esté bien, con sus propias palabras a partir de los borradores que la inteligencia artificial haya producido.

Que grupos de estudiantes escriban dos o tres textos que les haya encargado el profesor con inteligencia artificial y dejar que los estudiantes lo critiquen pienso que puede ayudar a los estudiantes a focalizarse más en aspectos de mayor nivel y no tan solo en aspectos centrados en el estilo. Otra cosa es que estas nuevas tecnologías, como el ChatGPT, pueden ser un compañero de conversación. Por lo tanto, un estudiante puede rebotar ideas y se puede usar, por ejemplo, para construir un argumento. Se le da un argumento desde una determinada perspectiva y esto hace que el ChatGPT te dé un argumento con otro enfoque y mantienes un diálogo con él. De este modo, queremos que los estudiantes sean más buenos en la argumentación y mejores para mantener conversaciones, utilizando la inteligencia artificial como compañero.

“Nuevas tecnologías, como el ChatGPT, pueden ser un compañero de conversación (...). Se le da un argumento desde una determinada perspectiva y esto hace que el ChatGPT te dé un argumento con otro enfoque y mantienes un diálogo con él. De este modo, queremos que los estudiantes sean más buenos en la argumentación y mejores para mantener conversaciones, utilizando la inteligencia artificial como compañero”

¿Esto implicará que cambie el rol del profesorado?

Creo que el papel del profesor tiene que cambiar y no basar tanto las evaluaciones en textos escritos. Tenemos que decidir en qué aspectos los estudiantes pueden utilizar sus propios pensamientos y ejercitar su propia creatividad y cómo evaluarlos con exámenes orales, y también valorar donde permitimos el uso de la IA entre los estudiantes, probablemente para la mayoría de los textos escritos. Tenemos que ayudar a los estudiantes con la tecnología, no contra la tecnología.

Pero la tecnología evoluciona más rápido que los sistemas educativos y probablemente a corto plazo puede causar algunos problemas en la dinámica educativa en las aulas. ¿Qué aconseja a los profesores para que resuelvan estos problemas a corto plazo?

Creo que será muy disruptivo a corto plazo, ya lo ha estado en las últimas semanas. Si hubieras preguntado a los estudiantes si habían oído hablar de GPT en diciembre, la mayoría de ellos no lo conocen y, si se lo pides ahora, casi todos ellos saben qué es y solo ha pasado un mes. Las cosas se están moviendo rápidamente. Los estudiantes presentarán tareas utilizando la IA e, inmediatamente, creo que los profesores tendrán que decidir si evaluarán del mismo modo o cambiarán su evaluación y si todavía darán puntos para el estilo ortográfico, cuando la IA también se ocupa de esto. Creo que prohibir el uso a los estudiantes no es la respuesta. Igual que nos adaptamos muy rápidamente al coronavirus y a la pandemia, creo que ahora tenemos que adaptarnos muy rápidamente a la Inteligencia Artificial y desarrollar nuevas maneras de evaluar.

“Creo que prohibir el uso a los estudiantes no es la respuesta. Igual que nos adaptamos muy rápidamente al coronavirus y a la pandemia, creo que ahora tenemos que adaptarnos muy rápidamente a la Inteligencia Artificial y desarrollar nuevas maneras de evaluar”

El Instituto de Tecnología Educativa de Londres del cual forma parte ha abordado en algunos de sus informes anuales como la educación puede adaptarse en la era de la inteligencia artificial. ¿Para facilitar esta adaptación, que además tendrá que ser rápida, qué hay que tener en cuenta?

Creo que necesitamos una nueva alfabetización en IA, del mismo modo que ha hecho falta una alfabetización informática, sobre cómo detectar noticias falsas, sobre cómo hacer uso de los correctores ortográficos... Creo que una alfabetización de inteligencia artificial tiene que facilitar, en primer lugar, que se pueda aprender a utilizar los sistemas generativos de inteligencia artificial productivamente, no utilizarlos como sustituto del pensamiento, sino para potenciar la argumentación del pensamiento, para apoyar al aprendizaje de los estudiantes. En segundo lugar, tenemos que pensar más allá, sobre la repercusión que tendrá la IA en el mundo de la industria y laboral.

En el mundo laboral, se aceptará que utilices estas herramientas de inteligencia artificial para generar informes de empresa; para generar programas de ordenador. Así que, hay que preparar a los estudiantes para usar estas herramientas porque, más allá de la Universidad, estarán aceptadas.

Durante el seminario a la UPF, ha habido una pregunta de estudiantes sobre cómo los afectará todo esto y ellos quieren aprender, pero también están preocupados porque no quieren quedarse atrás. Por lo tanto, tenemos que poder trabajar con los estudiantes una nueva política que desarrolle maneras productivas de trabajar con estas tecnologías.

¿Puede ser problemático utilizar la inteligencia artificial para todo?

Creo que siempre hemos tenido dependencia de las máquinas. Siempre hemos tenido tecnologías en educación, por ejemplo, la escritura era una tecnología a la Antigua Grecia. Existía la preocupación que, si utilizabas la escritura, entonces se pararía la capacidad de memorización, así que hemos tenido miles de años de tecnología y educación.

En nuestra época, ha surgido el peligro que la tecnología pueda desempoderar a las personas y desincentivarlas de aprender a calcular, porque una calculadora de bolsillo hace la aritmética por ti, o de estudiar un idioma, porque ya hay traductores automáticos. Este es un problema constante de la educación y nos tiene que servir para determinar cómo confiamos en las máquinas y cómo enseñamos a los estudiantes a ser autosuficientes y autónomos. No creo que sea fácil.

Cuando la educación consiguió acomodarse a las calculadoras de bolsillo, ya no esperaba que los estudiantes siempre hicieran cálculo mental, pero todavía los enseñamos cómo hacer una división y una multiplicación largas. Creo que lo mismo pasará con los generadores de idiomas. Tendríamos que enseñar a los estudiantes a cómo escribir bien, y seguir enseñándolos a expresar y a construir un argumento, a escribir claramente, a producir un estilo diferente. Todavía necesitan aprender esta escala básica, pero también tendremos que permitirles utilizar la tecnología.

En estos momentos, ¿las aplicaciones desarrolladas por la inteligencia artificial ya están tan desarrolladas que pueden escribir como un humano o presentan limitaciones?

Tienen límites y su límite principal es que no tienen un modelo interno de cómo funciona el mundo. Son máquinas lingüísticas, así que pueden construir piezas de texto muy plausibles, pero, a veces, cometen errores realmente estúpidos, por ejemplo inventan estudios de investigación o producen referencias académicas falsas, no porque intenten engañar, sino porque no son una base de datos y tampoco están actualizadas. Fueron entrenadas el 2020 y el 2021, así que ya están un año y medio desfasadas y no tienen mucho conocimiento contemporáneo. Los estudiantes tendrán que entender qué limitaciones tiene la inteligencia artificial y no pueden aceptar nada que produzca literalmente. Por lo tanto, los estudiantes tienen que ser los lectores más críticos y tienen que aprender a leer e interpretar los resultados de estos sistemas de inteligencia artificial.

“Los estudiantes tendrán que entender qué limitaciones tiene la inteligencia artificial y no pueden aceptar nada de lo que produzca literalmente. Por lo tanto, los estudiantes tienen que ser los lectores más críticos y tienen que aprender a leer e interpretar los resultados de estos sistemas de inteligencia artificial”

¿Existe el riesgo que los textos producidos por la inteligencia artificial estén sesgados en función del tipo de datos que tomen como referencia en la red para producirlos?

Los primeros sistemas GPT2 y las primeras versiones de GPT3 tenían sesgo porque estaban entrenados en Internet, con los textos que se encuentran en la red, e internet no es una enciclopedia. La compañía ha intentado corregirlo, intentando identificar ejemplos de sesgo y después adaptar el sistema para superar estos sesgos, pero esto es muy difícil. Supone que tienes que identificar todos los posibles sesgos: religiosos, éticos... Hay muchos tipos diferentes de sesgo y, cuanto más potente sea el sistema, más probable es que esté sesgado, porque habrá leído más textos en Internet y no solo habrá leído unas cuántas páginas de la Wikipèdia. Habrá leído blogs, tuits, etc. y muchos de ellos estarán sesgados y contendrán opiniones...

¿Esto puede suponer riesgos en el campo del periodismo?

Sí, existe el peligro de sesgos y sesgos sutiles. El sesgo de género es bastante obvio, pero hay sesgos más sutiles, por ejemplo el de una visión del mundo orientada a Occidente o hacia una nación; o sesgos culturales, que se incorporan a causa de las lenguas utilizadas... Por lo tanto, si lo utilizas para el periodismo, lo tienes que hacer bien. Si tú como periodista solo confías en que conoces la tecnología para hacer tu trabajo y no compruebas los hechos, no estarás haciendo buen periodismo.

¿Qué parte de la creatividad puede ser mecanizada y qué parte es esencialmente humana?

Hoy por hoy, estas herramientas generativas de la IA son muy expertas con el lenguaje, pero no tienen ningún modelo subyacente de cómo funciona el mundo. No tienen ninguna estructura de datos que represente este conocimiento. Sería necesario combinar la IA de la red neuronal de datos con la IA simbólica más antigua, que representa explícitamente cómo funciona el mundo, es decir, cruzar estructuras de datos sobre el conocimiento humano con las máquinas de lenguaje, pero esto es una gran tarea. Hace falta un cambio de fase para integrar la IA simbólica y la IA de red neuronal y estamos en un estadio temprano para poder hacerlo. Ni siquiera sabemos si será posible, así que es un momento muy emocionante.

Tenemos muchas posibilidades en el futuro con la inteligencia artificial y la creatividad, no solo para escribir, sino que también se puede aplicar al arte, al video, al discurso...

Aunque apenas nos encontramos en la fase inicial de lo que puede representar la inteligencia artificial, ¿considera que las políticas y leyes en el ámbito educativo, universitario... tendrán que cambiar en la era de la IA?

Sí, por ejemplo, las leyes de derechos de autor de la UE excluyen las máquinas de inteligencia artificial, puesto que asumen que las obras creativas solo son producidas por los humanos, pero se están consiguiendo obras producidas por máquinas.

Habrá un montón de presiones sobre las universidades, las escuelas, las instituciones, los medios... para adaptarse y siempre es peligroso, porque puedes cometer errores, así que espero que las universidades cambien eficazmente, trabajando con los estudiantes para hacer este cambio. No solo lo tendrán que hacer las universidades, puesto que las herramientas de inteligencia artificial pueden tener un gran impacto sobre el mercado laboral y hay algunas profesiones que desaparecerán en el futuro. Creo que, como con cada nueva tecnología, algunas profesiones desaparecerán y se crearán otras.

“Habrá un montón de presiones sobre las universidades, las escuelas, las instituciones, los medios... para adaptarse y siempre es peligroso, porque puedes cometer errores, así que espero que las universidades cambien eficazmente, trabajando con los estudiantes para hacer este cambio”.

Si se generan nuevas profesiones, ¿también habrá que generar nuevos tipos de estudios en las universidades?

Lo que espero es que haya más estudios interdisciplinarios, porque estos son la intersección de la neurociencia, de la ciencia de datos, del aprendizaje automático, de la inteligencia artificial simbólica, de las matemáticas, del lenguaje natural... Por lo tanto, si realmente queremos avanzar, tenemos que tener un enfoque interdisciplinario fuertemente radical.

Yo trabajaba en la Universidad de Sussex en la escuela de ciencias de la computación cognitiva y, de punta a punta del pasillo, tenías un matemático, un neurocientífico, un procesador de lenguaje natural, un experto en inteligencia artificial... que hablaban juntos y era muy emocionante y enormemente productivo. Creo que el camino a seguir es unir equipos radicalmente interdisciplinarios y aquí en la UPF tenéis una gran oportunidad para hacerlo.

“El camino a seguir es unir a los equipos radicalmente interdisciplinarios y aquí en la UPF tenéis una gran oportunidad para hacerlo”

¿Los estudios humanísticos tienen futuro?

Sí, pero creo que serán estudios humanísticos que incluirán la inteligencia de las máquinas, como herramientas capaces de generar contenidos creativos. Los músicos modernos ya utilizan sintetizadores tecnológicos o unidades de reverberación como parte esencial de tu creatividad.

Creo que habrá estudios humanísticos en los que habrá que buscar maneras en las que la tecnología se ponga al servicio de la humanidad y hacerlo con mucho cuidado, porque hay grandes peligros. Como humanos, siempre nos hemos adaptado a nuestro entorno y también hemos creado nuestro entorno y ahora estamos creando un entorno informático y de máquinas y nos estamos adaptando. Así que tendremos que hacer que los humanos, aprendan a ser creativos de otro modo, con una creatividad que implicará las nuevas máquinas.

“Tendremos que hacer que los humanos, aprendan a ser creativos de otro modo, con una creatividad que implicará a las nuevas máquinas”

Mucho antes del actual debate sobre los riesgos de la inteligencia artificial en el campo educativo, otras muchas tecnologías digitales y multimedia ya se habían introducido en las aulas. De hecho, usted investiga sobre las aplicaciones tecnológicas en el campo educativo desde los años 70 del siglo XX. En términos generales, ¿como cree que la tecnología ha repercutido positivamente en la educación durante las últimas décadas?

Creo que, en general, se han seguido dos corrientes paralelas. Por un lado, está la corriente en la que se han intentado inventar nuevas máquinas para la enseñanza, por ejemplo Skinner (dispositivo mecánico para controlar los progresos de los estudiantes a través de la programación), los tipos de máquinas de aprendizaje personalizados, sistemas de tutoría inteligentes... Esta es una corriente que continúa para obtener un mayor número de tecnologías para la enseñanza cada vez más sofisticadas, máquinas de enseñanza y máquinas de evaluación y herramientas para apoyar a los profesores. Por otro lado, está la corriente más subversiva, en la que los estudiantes han adoptado la tecnología que los ayuda a aprender a menudo en confrontación o en oposición a los sistemas de educación tradicionales, ya sean calculadoras de bolsillo o teléfonos móviles o sistemas de traducción automática. Esta segunda corriente se corresponde con lo que está pasando ahora. Nuestros estudiantes se han vuelto impulsores de repente en las universidades de la IA y las universidades tienen que reaccionar.

Pero también podríamos juntar estas dos corrientes, porque, gracias a la inteligencia artificial, se puede tener estudiantes más empoderados, pero a la vez con más herramientas para disfrutar de un mejor aprendizaje.

¿Considera que alguna universidad está emprendiendo alguna buena práctica interesante en cuanto a la integración de la inteligencia artificial en la enseñanza?

Creo que hay etapas con cada nueva tecnología y parecen ser siempre las mismas etapas: en primer lugar, ignorarla y esperar que pase; después, prohibirla o al menos restringir su uso; y, finalmente en una fase tardía, acomodarla e intentar desarrollar una nueva pedagogía a su alrededor. Esto es tan nuevo que hemos pasado por estas etapas en cuestión de semanas más que de meses o años

Durante el último año, creo que la mayoría de universidades lo han ignorado, a pesar de que estaba claro que los estudiantes ya estaban empezando a utilizar la tecnología de inteligencia artificial. Ahora, algunas universidades han empezando a restringirlo y, en algunas, se está experimentando pero tienden a ser más iniciativas de profesores individuales que están experimentado con sus estudiantes escribiendo papers de investigación o blogs entorno a ello, pero lo que está claro es que hoy en día esto es una cuestión de dos o tres académicos. No creo que haya ninguna universidad que haya aplicado cambios fundamentales en sus políticas para incorporar los sistemas de inteligencia artificial o para cambiar sus métodos de enseñanza para incorporarla, porque todavía no se ha escrito una política universitaria a respecto. Esto supondrá unas cuántas semanas o meses, y esto ha pasado tan recientemente... Pienso que pasará y creo que habrá algunas universidades pioneras, pero todavía no ha pasado.

“No creo que haya ninguna universidad que haya aplicado cambios fundamentales a sus políticas para incorporar los sistemas de inteligencia artificial o para cambiar sus métodos de enseñanza para incorporarla (...) Pienso que pasará y creo que habrá algunas universidades pioneras”