¿Cómo convivirá la IA con la música humana? El futuro ha llegado

¿Cómo convivirá la IA con la música humana? El futuro ha llegado

Reportaje de Karma Peiró*

Imagina un mundo en el que la próxima canción de éxito no la escriba una persona que compone, sino una máquina. Este futuro podría ya haber llegado. Tras los rápidos avances de la inteligencia artificial y otras nuevas tecnologías, el Music Technology Group (MTG) de la Universidad Pompeu Fabra ha dirigido un proyecto para analizar los cambios en la forma de crear, distribuir y escuchar música.

La música compuesta por ordenador no es nueva: las primeras composiciones de este tipo se remontan a finales de la década de los 50. Pero, cuando en 2017 la banda de rock británica MUSE generó un vídeo para su nuevo single "Dig Down" utilizando lo último en inteligencia artificial (IA) y capacidades de aprendizaje automático, la respuesta de los fans fue enorme. La herramienta utilizada por la banda fue rastrear por Internet para encontrar cientos de horas de imágenes de famosos, políticos y artistas. A continuación, los clips se ‘hilaron’ entre sí utilizando señales temporales de la canción original, con cada letra pronunciada por una persona diferente.

"La inteligencia artificial se utiliza a menudo de forma muy invisible, por lo que fue emocionante trabajar con el grupo en un proyecto que la ponía en primer plano", informó Branger Briz, la agencia de desarrollo tecnológico que colaboró con el grupo. "Creemos que es importante debatir públicamente las promesas y los peligros de estas tecnologías emergentes y con una influencia increíble".

Sólo dos años después, el grupo de pop transfronterizo YACHT fue aún más lejos. La banda se propuso el mayor reto de sus diecisiete años de carrera invitando a la IA a participar en su proceso creativo. "Queríamos encontrar una forma de cuestionar la tecnología más profundamente", explica la vocalista Claire L. Evans. Evans y sus compañeros de banda -Jona Bechtolt y Rob Kieswetter- seleccionaron a mano sus composiciones favoritas de IA y luego las incorporaron en las canciones que componen el exitoso álbum nominado a los Grammy, Chain Tripping. "Realmente no sabíamos lo que era posible hacer con la inteligencia artificial. Sólo sabíamos que de alguna manera tenía que ir más allá de la música ambiental generativa", argumentó Evans en una charla para Google.

Para producirlo, la banda primero intentó desenterrar cualquier fórmula existente de YACHT colaborando con ingenieros y tecnólogos creativos y explorando su propio catálogo de 82 canciones mediante herramientas de aprendizaje automático. Melodías, letras, ilustraciones y vídeos fueron creados por el sistema inteligente. "Este disco es producto de un momento tecnológico que evoluciona rápidamente. No nos propusimos producir música generada algorítmicamente que pudiera ‘parecer’ humana. Nos enseñó todo lo que queríamos saber sobre nosotros mismos: cómo trabajamos, qué nos mueve y qué terrenos merece la pena explorar a pesar de su ambigüedad”, explica Evans.

Todo el proceso se plasmó en el documental The Computer Accent (estrenado en 2022), que documenta la investigación, composición y grabación y permite al espectador experimentar los temores y el asombro de la banda ante las potenciales capacidades de la IA actual. La realización de este álbum suscitó preguntas sobre su papel en un futuro, dado que el software anticipa, genera e incluso sintetiza el trabajo humano, así como sobre las cuestiones éticas relevantes del momento.

Ambos ejemplos, de MUSE y YACHT, ya estarán desfasados para cuando lean este artículo. Como se decía al principio: la música compuesta por ordenador no es nada nuevo, pero la diferencia hoy es que pronto, gracias a la IA, se abrirá la posibilidad de crear la próxima canción de éxito sin ningún conocimiento o habilidad musical previa. Cualquiera podría hacerlo. Entonces, ¿será la IA una aliada de la creatividad musical? ¿Puede la música generada por máquinas tener el mismo efecto en los oyentes que la música hecha por humanos? ¿Con qué rapidez adoptará la industria esta innovación y con qué rapidez la adoptaremos nosotros? ¿Qué cuestiones éticas plantea esta revolución? Aún no hay respuestas concretas.

La tecnología avanza a la velocidad de la luz. Al menos eso es lo que parece. Y no estamos frenando, sino volando con una súper velocidad hacia un destino desconocido. Estamos en un avión, en las nubes, sin una visión clara, con pocas pistas sobre dónde acabaremos y muchas preguntas sin respuesta. Abróchense los cinturones. Nos espera un viaje movidito.

Reunir a todas las voces

La inteligencia artificial es hoy la estrella entre las tecnologías del ámbito creativo. El año pasado nos quedamos entusiasmados y con la boca abierta ante sistemas que generan imágenes a partir de descripciones de texto, como Dall-E, Midjourney o Stable Diffusion. Era lógico suponer que la innovación relacionada con la música podría ser lo siguiente.

En el último trimestre de 2022, el Music Technology Group (MTG) de la Universidad Pompeu Fabra puso en marcha el proyecto Retos y Oportunidades en tecnología musical para identificar cómo la IA y otras nuevas tecnologías están cambiando los procesos de creación, distribución, aprendizaje y escucha de música.

Para desarrollar soluciones que apoyen una transformación digital justa y transparente del sector, es crucial comprender las necesidades y preocupaciones de todas las partes interesadas. Desde 1994, el MTG investiga a escala internacional temas como el procesamiento de señales de audio, la recuperación de información musical, las interfaces musicales y la musicología computacional. Su principal objetivo es contribuir a la mejora de las tecnologías de la información y la comunicación relacionadas con el sonido y la música y, al mismo tiempo, comunicar sus hallazgos a la sociedad en general: "El concepto de ciencia abierta es fundamental en el mundo académico, y eso significa que queremos evitar el aislamiento. Durante años hemos hecho grandes esfuerzos para ser más accesibles, y este proyecto va en esa dirección", explica Xavier Serra, director del MTG.

Con este objetivo en mente, de septiembre a diciembre de 2022, este grupo de investigación celebró un debate abierto entre las principales partes interesadas en la música (ejecutivos de la industria, creadores, oyentes, estudiantes de música, archiveros, desarrolladores, etc.) para analizar los retos y oportunidades de la IA para el sector musical, pero también el impacto que tendrá en la sociedad y la cultura, probablemente muy importante. "Este cambio tendrá implicaciones para todos, no sólo para los músicos del sector. Por eso nos pareció importante escuchar también las voces silenciosas implicadas en este cambio tecnológico", añadió Serra.

"¿Cómo están cambiando la IA y otras nuevas tecnologías los procesos de creación, distribución, aprendizaje y escucha de música?"

A través de diversos formatos -encuestas, entrevistas en profundidad y un evento presencial con el público-, se dedicaron cuatro meses a recopilar pensamientos, reflexiones, preocupaciones y aspiraciones futuras del sector musical en relación con la inteligencia artificial y otras tecnologías emergentes como el blockchain y el metaverso. Este artículo refleja los debates, sugerencias y comentarios de cien colaboradores, tanto del sector musical internacional como del local, comprometidos con la creatividad, la escucha, la educación y el archivo de la música que consumimos hoy en día.

"Aprendizaje automático"

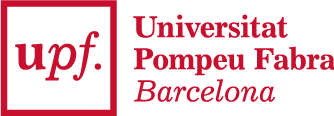

Una de las principales conclusiones del proyecto MTG es que los músicos "sin duda se beneficiarán muy pronto de la IA". La IA podría ayudar a los músicos en toda una serie de tareas: composición, síntesis, búsqueda de muestras, mezcla y masterización. Sin embargo, algunos de los encuestados señalaron "problemas con interfaces poco amigables, habilidades difíciles de adquirir o simplemente resultados poco convincentes".

La solución podría venir de la mano de Google. En enero de 2023, se estrenó la última herramienta de IA de la compañía tecnológica simplificando lo que parecía un inconveniente para el sector. El sistema puede generar música, de cualquier género, a partir de una descripción de texto. El artículo "MusicLM: Generating music from text" describe cómo se entrenó el algoritmo con un conjunto de datos de 280.000 horas de música para generar piezas de un minuto de duración a partir de indicaciones o descripciones de texto. Para quienes no deseen cursar tres o cuatro años de carrera musical o una formación técnica que requiera mucho tiempo, todo lo que necesita esta nueva herramienta es una breve instrucción, por ejemplo: "Crea una melodía de jazz suave con un solo de saxofón pegadizo y un cantante solista" o "Techno berlinés de los 90 con un bajo grave y un sonido fuerte de bombo de batería".

¿Puede esta máquina hacer música de forma tan creativa como la que hacen los humanos? Si es así, podría convertirse en una inspiración, un compañero, la solución perfecta al bloqueo del escritor. Pero si las composiciones de la máquina cuentan con la aprobación de los oyentes, ¿será la IA una competencia para los músicos?

"Los músicos se beneficiarán sin duda de la IA en tareas como la composición, la síntesis, la exploración de muestras, la mezcla y la masterización"

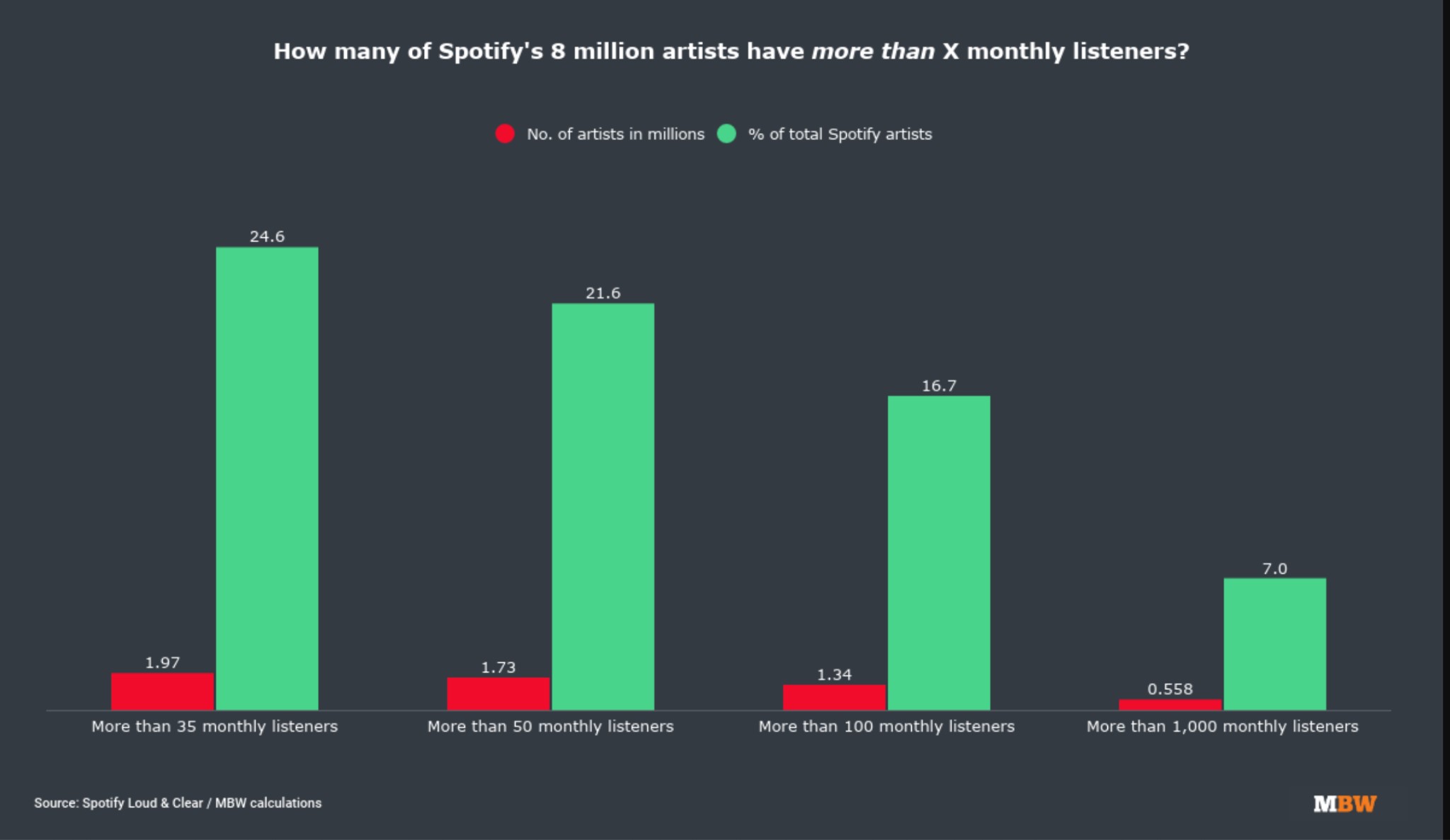

La situación actual también plantea otros retos derivados de la relación con las nuevas tecnologías. El 71% de los participantes en la encuesta del proyecto MTG cree que la IA podría conducir a una sobreproducción y a una disminución del valor musical. Sobre este último punto, ya es un hecho que el aspecto económico de la creación musical se está diluyendo. El estudio "Music creators' earnings in the digital era", publicado por la Oficina de Propiedad Intelectual del Reino Unido en 2021, confirma estos temores. Este estudio pionero concluye que sólo aquellos artistas que consigan alrededor de un millón de streams (reproducciones en plataformas de streaming que no requieren descargar la canción) al mes durante un periodo prolongado podrán vivir de la música en el Reino Unido. "En el Reino Unido, eso supone sólo el 0,4% de los músicos en las plataformas de streaming", dice el informe.

¿Acabar con los intermediarios?

En un contexto con estas condiciones, surgen otras preocupaciones relacionadas con la disrupción tecnológica que estamos experimentando actualmente. Por ejemplo, la reducción o desaparición de muchos músicos profesionales. ¿Qué ocurrirá con los cantantes de estudio que -entre otros- se verán afectados por la IA? La música funcional -como la que puede escucharse en restaurantes, balnearios, ascensores, etc., y que a menudo pasa desapercibida para el público al que va dirigida- puede ser compuesta hoy en día por máquinas. Parece que este trabajo puede estar desapareciendo como actividad humana. Tiene sentido: ¿qué empresa estaría dispuesta a pagar a un profesional anónimo cuando puede obtener cientos o miles de horas de "muzak" (hilo musical) libre de derechos a través de una cuota de suscripción?

La homogeneización y el predominio de la estética musical comercial occidental es otra amenaza a la que hay que hacer frente. Lo que aún no está claro es si la música de IA se limitará a hacer más de lo mismo, cultivando temas trillados del pop global, o si tendrá la capacidad de sacar a la luz nuevas joyas sonoras, descubrir territorios musicales inexplorados y crear nuevos géneros que ningún músico haya explorado todavía.

"Nos dirigimos a un mundo entre iguales donde tota relación entre creadores y fans será directa”

Además de la IA, otras tecnologías como el blockchain/NFT o el metaverso apuntan a una posible transformación del sector musical, pero aún encierran muchas incógnitas. Blockchain promete eliminar a los intermediarios, pero antes de que esto sea una realidad, la cuestión es si la industria lo permitirá. "Blockchain aportará claridad a los problemas actuales de los derechos legales de los artistas. Es una gran tecnología que se centra principalmente en los creadores y el público", dice Marcelo Estrella, asesor de propiedad intelectual de Across Legal, especializado en tecnología e innovación legal. "Facilita el proceso de registro de transacciones y el seguimiento de activos en una red empresarial. A los artistas, les permitirá disponer de una completa base de datos que almacenará información detallada sobre los derechos de autor y la propiedad intelectual de la música. Esto ayudará a los artistas a acreditarse por su trabajo creativo", añadió.

"Inmutable, transparente, público e inalterable" son algunos de los calificativos que utilizan los partidarios del blockchain para afirmar que esta tecnología está llamada a aplicarse -en este ámbito- en un futuro próximo. "Además contamos con la ventaja de las NFT (representaciones de activos en las redes blockchain) como vehículos, un enlace directo entre creadores y audiencias"- sostiene Marcelo Estrella, que añade: "llevará a la inevitable eliminación de los intermediarios. Abordamos un mundo peer-to-peer donde “tota relación entre creadores y fans será directa”. Esto tendrá un fuerte impacto en la sociedad, como los pagos instantáneos a través de los contratos inteligentes; o los datos que las audiencias pueden proporcionar a los creadores".

Los humanos en el circuito de interacción con las máquinas, ¿sí o no?

Nadie discute el hecho de que las actuales herramientas de IA tienen un enorme potencial, y se predice que se descubrirán nuevos sonidos y ritmos y se inventarán nuevos géneros gracias a la interacción hombre-máquina. Los sistemas inteligentes actuales pueden crear música a una velocidad inimaginable hasta ahora. Pero, ¿desplazará la IA al creador musical y se convertirán los oyentes en fieles seguidores de canciones producidas exclusivamente por máquinas?

"Para mí, si los humanos se quedan fuera del circuito, va a ser un futuro triste", dice Rob Clouth, artista multidisciplinar que trabaja en los campos de la música electrónica, la sónica computacional y los nuevos medios. "Creo que siempre habrá músicos artesanos que aprecien el proceso de creación. Para mí, parte de lo que significa hacer música es pensar en lo que le gustará a otra gente".

La comisaria musical Antonia Folguera tiene una opinión diferente: "Como oyente, no me importaría que mi próxima canción favorita estuviera hecha por la IA", dice. "Si es buena, ¿por qué no? Pero sería un poco aburrido porque querría saber más sobre quién está detrás de esa canción. Y si descubriera que el autor es un programa informático, me aburriría muy rápido". Sin embargo, Folguera confiesa que cuando actúa como DJ, hay muchas ocasiones en las que busca un ritmo o un sonido específico y, en ese contexto, poder utilizar la IA sería una gran ventaja. También le parece bien quitar a los humanos la carga de tener que crear lo que se conoce como "música de ascensor".

La productora de música electrónica experimental y profesora titular de Tecnología de Audio Musical en la Universidad De Montfort (Reino Unido) Anna Xambó, argumenta: "¿Por qué no pensar con originalidad y seguir las ideas del investigador Nick Collins sobre la posibilidad de un sistema autónomo sin interacción con los humanos? Estamos al principio del viaje". En esta línea, el Ai Music Generation Challenge 2023 de este año, que en años anteriores se había centrado en la creación de composiciones de diferentes tradiciones musicales, se centra de hecho en la creación de una nueva "tradición" de musical artificial.

Las dudas son naturales

Llegados a este punto, el debate deriva hacia cuestiones éticas inevitables, ya que sabemos de antemano que no existe una respuesta o solución segura. Si utilizamos la inteligencia artificial para crear algo, ¿quién debe considerarse propietario de esa obra? ¿Los programadores del modelo? ¿Los autores del conjunto de datos de entrenamiento? ¿El formador, el comisario, el músico que está detrás? ¿La empresa propietaria del modelo o la herramienta? ¿La propia IA? ¿Debemos seguir atribuyendo la autoría a cualquiera? ¿Qué dicen las leyes actuales al respecto? Si aún no hemos conseguido una remuneración justa para los músicos, ¿cómo resolveremos esta ambigüedad tecnológica que analiza millones de sonidos para crear algo completamente diferente?

Todos los consultados por el proyecto MTG coinciden en el hecho de que se trata de una cuestión difícil y que debatiremos durante mucho tiempo.

Todos los sistemas de inteligencia artificial más recientes -como Dall-e y otros- nos dan resultados tras mezclar millones de imágenes, sonidos y textos sin acreditar nunca a un creador humano, y no ofrecen ningún estímulo para que los usuarios profundicen y exploren más a fondo el trabajo de los artistas, escritores, científicos o investigadores originales. Si estas herramientas se utilizan a gran escala, ¿dependeremos cada vez más de sus resultados sin tener la oportunidad de explorar nuestro pasado de otra manera?

"Quizá deberíamos reflexionar sobre la propiedad colectiva, aceptar una multiplicidad de autores, saltarnos la figura romántica del compositor"

El artista Rob Clouth sugiere una solución: "Dall-e podría mostrar las diez imágenes más parecidas de su base de datos con enlaces a los sitios web de sus autores. Eso tiene más que ver con la atribución de la autoría que con la propiedad, pero algo es algo".

El abogado Marcelo Estrella recuerda el panorama actual en Europa. La legislación de derechos de autor de la UE prevé que las creaciones de IA se clasifiquen como "obras". Así que, a menos que se pueda demostrar que la creación de la IA entra en uno de estos supuestos, forma parte directamente del dominio público:

- Primer paso: La producción asistida por IA debe ser una producción en el ámbito literario, científico o artístico.

- Segundo paso: El resultado de la IA debe ser fruto del esfuerzo intelectual humano.

- Tercer paso: La salida asistida por IA debe ser original.

- Cuarto paso: La obra debe ser identificable con suficiente precisión y objetividad.

El dominio público significa que nadie es propietario de la obra, sino que es propiedad del público. Cualquiera puede utilizar una obra de dominio público sin obtener permiso y sin citar al autor original, pero nadie puede poseerla. Por supuesto, estas posibles situaciones se basan en los principios jurídicos europeos. La situación es diferente en otras partes del mundo. Un libro blanco del cual es autor Eric Sunray, pasante jurídico de la Music Publishers Association y especialista del Washington College of Law de la American University, sostiene: "los generadores de música por IA violan los derechos de autor de la música al crear tapices de audio coherentes a partir de las obras que adquieren para su entrenamiento, infringiendo así el derecho de reproducción de la Ley de Derechos de Autor de Estados Unidos".

"Chaleco salvavidas bajo tu asiento"

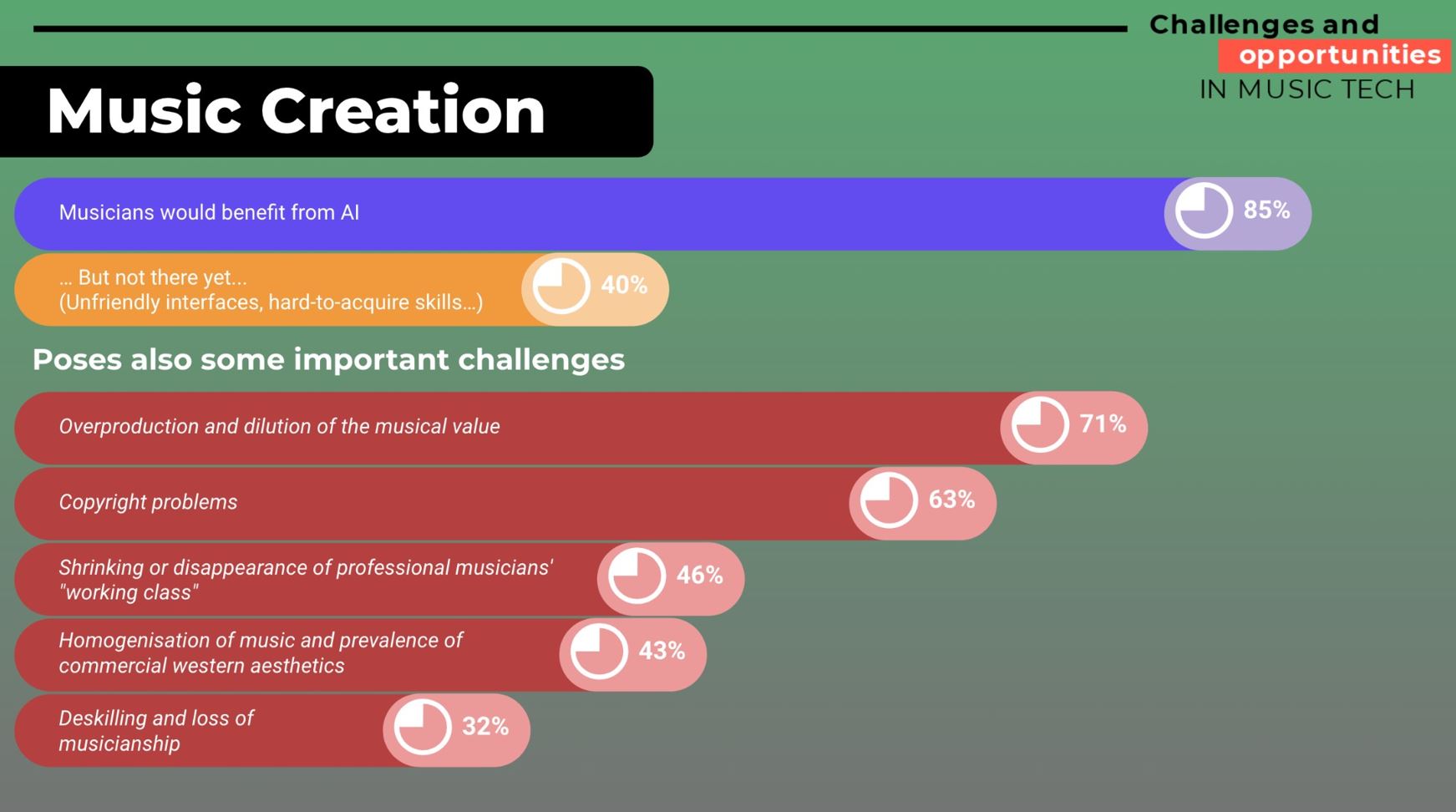

El debate ético se desató cuando, en enero de este año, un trío de artistas -Sarah Andersen, Kelly McKernan y Karla Ortiz- demandó a Stable Diffusion, Midjourney y la plataforma de carteras de artistas DeviantArt porque sus obras se utilizaron para alimentar los algoritmos de IA. "Estas empresas han violado nuestros derechos al entrenar sus herramientas de IA con cinco mil millones de imágenes de Internet sin contar con el consentimiento de los artistas originales", informa la publicación Verge. "A medida que aprendía más sobre cómo se entrena a los modelos de IA para medios audiovisuales, profundamente explotadores, me di cuenta de que no había ningún precedente legal para restituir este derecho". Karla Ortiz, tuiteó. "Vamos a cambiar eso".

Karla es puertorriqueña, trabaja en cine, videojuegos y televisión y es una apasionada defensora de la mejora de las industrias y los derechos de los artistas: "Estoy orgullosa de ser una de las personas que toma parte de esta demanda colectiva. Me enorgullece hacer esto con compañeros, que demos voz a miles de artistas potencialmente afectados. Estoy orgullosa de que ahora luchemos por nuestros derechos no sólo en la esfera pública, sino también en los tribunales", añade.

No son los únicos que denuncian la situación aventajada de estas empresas de IA. Getty Images también inició un procedimiento judicial este mes de enero en el Tribunal Superior de Justicia de Londres contra Stability AI, alegando que la empresa había infringido los derechos de propiedad intelectual. "Stability AI copió y procesó ilegalmente millones de imágenes protegidas por derechos de autor y los metadatos asociados, que son propiedad o están representados por Getty Images, y carece de licencia para utilizarlas en beneficio de sus intereses y en detrimento de los creadores de contenidos", según recoge un comunicado de Getty Images.

“A medida que aprendía más sobre cómo se entrena a los modelos de IA para medios audiovisuales profundamente explotadores, me di cuenta de que no había ningún precedente legal para restituir este derecho".

En respuesta a esta polémica, otro grupo de artistas, Spawning, lanzó hace un par de meses el sitio web "¿He sido entrenado?", que permite a cualquiera ver si sus obras de arte se han utilizado para entrenar algoritmos de IA. "Sería poco práctico pagar a humanos para que escribieran manualmente descripciones de miles de millones de imágenes para un conjunto de datos de imágenes", afirma el reportero de IA y aprendizaje automático de Ars Technica, Benj Edwards. "No buscan el consentimiento porque la práctica parece ser legal debido a las decisiones de los tribunales estadounidenses sobre el análisis de datos en Internet". Pero un tema recurrente en las noticias sobre IA es que el aprendizaje profundo puede encontrar nuevas formas de utilizar datos públicos que no se habían previsto previamente, y hacerlo de maneras que podrían violar la privacidad, las normas sociales o la ética de la comunidad, incluso si el método es técnicamente legal".

Esta es la batalla librada hasta ahora en el campo de las imágenes y los textos. Podemos suponer que muy pronto veremos reacciones similares en el sector de la música. En su tuit, el científico especializado en IA Jim Fan expresa muy claramente el momento que estamos viviendo: "La industria de la música y los efectos de sonido no ha comprendido del todo el tamaño de la tormenta que está a punto de caer. No hay uno, ni dos, sino cuatro nuevos modelos (de IA) de audio han aparecido sólo en la última semana. Si el 2022 es el año de los píxeles para la IA generativa, el 2023 es el año de las ondas sonoras".

Quizá deberíamos cambiar nuestras expectativas sobre la propiedad y buscar una iniciativa similar a las licencias Creative Commons (CC) que se crearon hace 20 años y ayudaron a organizar el permiso para utilizar una obra creativa, sugiere Anna Xambó. "Combino obras con licencias CC con mis propios sonidos, y no sabes de quién es cada cosa. Además, hay algunas piezas en las que influye el oyente. Entonces, ¿de quién es cada cosa? Quizá deberíamos reflexionar sobre la propiedad coral, aceptando una multiplicidad de creadores y saltándonos la figura romántica del compositor", concluye.

De los artistas al público

Entre los continuos dilemas que plantea la tecnología, no siempre es obvio dónde trazar la línea divisoria entre la producción y el consumo de música, ya que ambas partes están interconectadas.

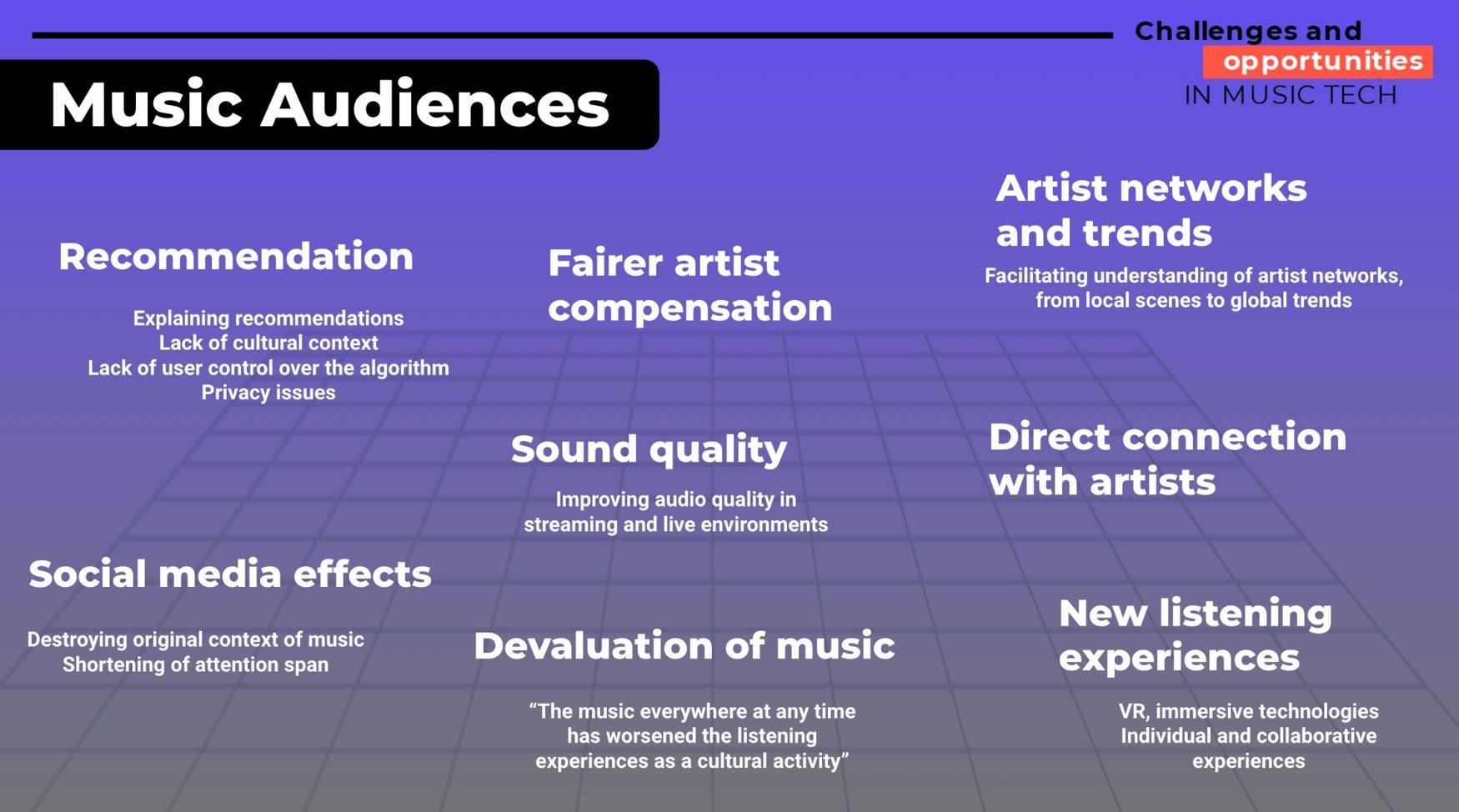

¿Cómo llega la música de los creadores a los oyentes y qué ocurre en este proceso cuando interviene la IA? Las "recomendaciones algorítmicas" no sólo se describen como un "logro tecnológico excepcional", sino también como algo que necesita mejorar. Estos sistemas, que están en plataformas como Spotify o YouTube, entre otras, siguen siendo percibidos por los profesionales como "cajas negras" y no dan ninguna pista de por qué recomiendan a los oyentes una canción y no otra. Los músicos tienen que depender de estos algoritmos para aumentar sus presupuestos publicitarios o llegar a nuevos grupos objetivo. Se quejan de la falta de control sobre el funcionamiento de estos algoritmos.

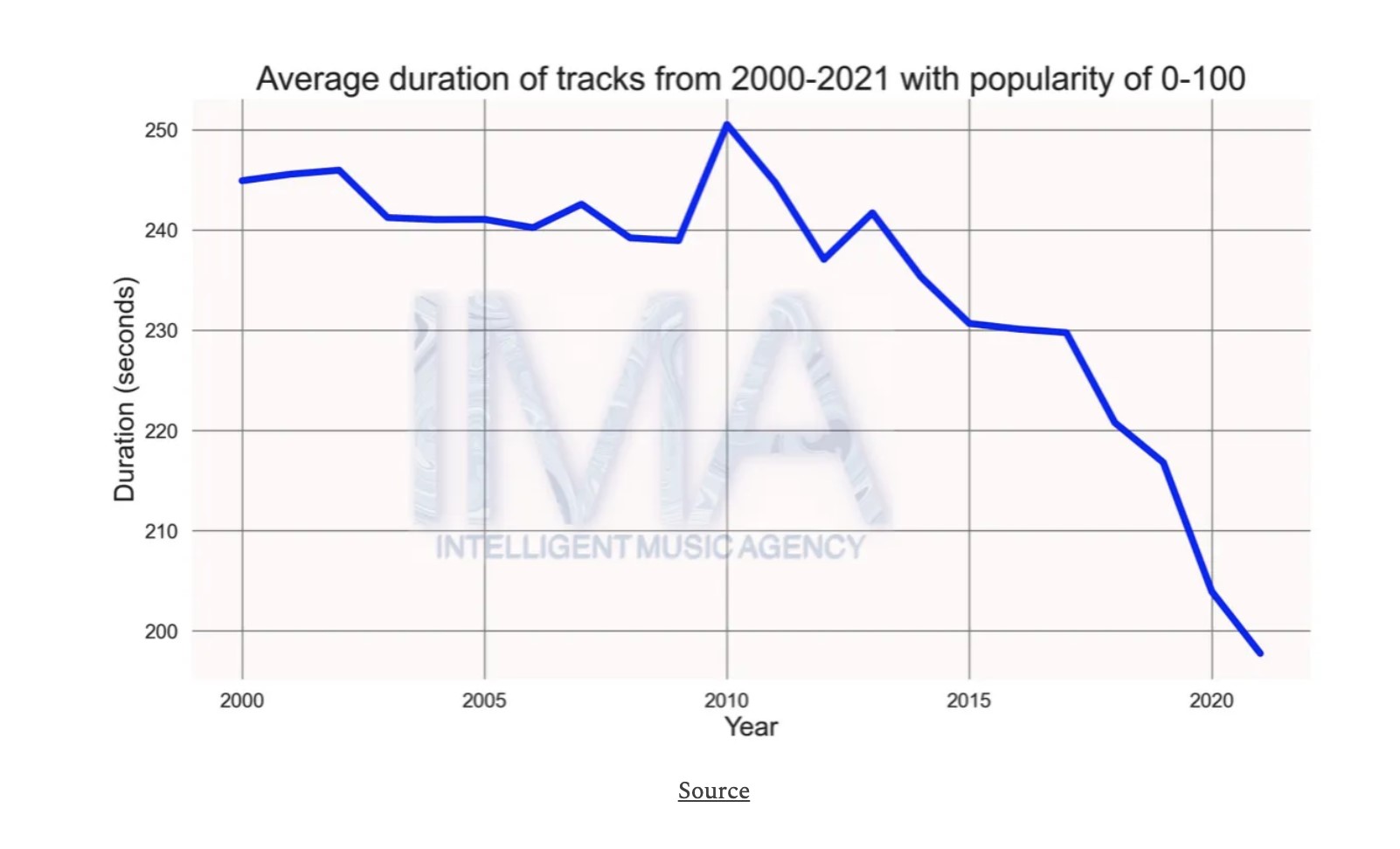

Si hoy nadie se atreve a prescindir de los algoritmos de recomendación, lo mismo ocurre con las redes sociales. Ambos son clave para atraer a nuevas audiencias y retener a las existentes, y son un gran problema para los creadores, que dependen cada vez más de las grandes empresas para presentar su trabajo al público. Por otro lado, los participantes en la encuesta de MTG consideran que las redes sociales son una amenaza potencial para la experiencia auditiva, porque destruyen el contexto original de la música y fomentan una menor capacidad de atención. "Las canciones han ido siendo cada vez más cortas durante bastante tiempo, pero recientemente las duraciones se han desplomado", anunciaba el informe "Duración de las canciones: ¿Cómo ha cambiado la tendencia a lo largo del tiempo y qué significa hoy?", dirigido por los investigadores Parth Sinha, Pavel Telica y Nikita Jesaibegjans.

"La tendencia a la baja de la duración de las canciones pone de manifiesto un claro patrón de disminución de la capacidad de atención del consumidor medio de música. También sugiere que las canciones más cortas tienen más posibilidades de llegar a más oyentes y captar su atención. Esto permite dar salida a más material, que puede repartirse en un mayor número de canciones más cortas", declaran los analistas. Quieren concienciarnos sobre cómo la creatividad y la visión artística personal se están devaluando fuertemente. ¿Cuánto tiene que durar una canción para que nos guste? Como ejemplo extremo, la canción viral de TikTok tiene una duración media de 19,5 segundos. "¿Dónde está el límite entre satisfacer las cambiantes preferencias de los usuarios y, al mismo tiempo, dejar espacio para la innovación?", reclaman los autores de este estudio. "La conclusión aquí es bastante obvia: a pesar de la innovación y la accesibilidad, también hay un impacto en la mentalidad global del artista musical en la producción, creación y promoción", razonan.

Otras cuestiones planteadas en la encuesta del MTG tenían que ver con el binomio artista-público, por ejemplo se les preguntaba por la opinión, muy arraigada en la industria, de que los artistas necesitan ser mejor compensados; una preocupación que la pandemia y el periodo pospandémico han agudizado más hoy en día. Desde el público, se hizo un llamamiento para permitir o fomentar las conexiones directas con los artistas y su público local, y mejorar la calidad del sonido tanto en streaming como en directo. Algunos encuestados también sugirieron habilitar "experiencias de realidad virtual", en eventos privados y colectivos.

Sobrecarga y devaluación

La sobrecarga de información y la devaluación de la música en las plataformas de streaming es otro motivo de preocupación: "La música en todas partes y en cualquier momento ha empeorado la experiencia de la escucha como actividad cultural", afirman algunos participantes en la encuesta. Recientemente se ha informado de que "cada día se suben 100.000 canciones a los servicios de streaming", lo que también dificulta cada vez más que los artistas emergentes, o incluso los consagrados, se abran paso y se hagan notar. Además, casi el 80% de los artistas en Spotify tienen menos de 50 oyentes mensuales, según el informe anual de 2021 de la empresa.

Al final, ¿cuáles serán los retos más importantes que la IA aportará al público musical? Expertos de plataformas de streaming y desarrolladores de software de IA tienen ahora la palabra. El director sénior de investigación de la plataforma PANDORA, Fabien Gouyon, nos insta a ser menos pesimistas, a mirar el lado positivo y también a considerar las oportunidades que presenta la tecnología actual. "Un reto que tenemos es cómo encontrar la interactividad adecuada para ofrecer al usuario. Para ello, existen diversas posibilidades: desde que los oyentes se limiten a pulsar pasivamente “play” hasta que tengan la capacidad de ajustar ellos mismos los algoritmos a sus gustos y según su propia curiosidad. ¿Cuál es el equilibrio adecuado para todos?"

"Cada día se suben 100.000 canciones a las plataformas de streaming, pero la mayoría de los artistas tienen menos de 50 oyentes mensuales"

El Director de Innovación de la empresa de tecnología musical BMAT, Gonçal Calvo, cree que el reto más importante hoy en día es la sobreproducción de música. "La digitalización nos una cantidad demasiado abundante y este hecho plantea problemas en cuanto a la gestión de los derechos de autor o los modelos de negocio. ¿Es posible una economía sostenible con 100.000 nuevas canciones cada día? Preveo fuertes tensiones en el próximo año en torno a esta cuestión". Calvo opina que las empresas están incentivando la música creada para la plataforma: "Los compositores saben qué cosas sonarán mejor en la lista de reproducción y la recompensa que les espera si la canción se reproduce más de 30 segundos. Hay un gancho y el oyente queda atrapado".

Ya en 2018, la escritora y editora establecida en Nueva York Liz Pelly destacó esta cuestión en un artículo para la revista Baffle: "Las tendencias musicales producidas en la era del streaming están intrínsecamente conectadas con la atención, ya sean ganchos para captar la atención duros y rápidos, gotas de pop y estribillos en bucle diseñados para los centros de placer de nuestros cerebros, o música que estratégicamente no requiere atención en absoluto: la música de fondo, la música de fondo emocional o temas populares de la lista de reproducción chill-pop-sad-vibe", dice. Pelly trabaja actualmente en su primer libro, Mood Machine: The Rise of Spotify and the Costs of the Perfect Playlist, que publicará Astra House en 2024.

Como ingeniero musical especializado en IA y consultor de empresas de tecnología musical, Valerio Velardo cree que la relación actual entre artistas y público puede cambiar mucho gracias a las tecnologías emergentes. "Hoy en día, los oyentes pueden convertirse en creadores de música con herramientas de IA. Pueden compartir experiencias musicales a través de la realidad virtual y el Metaverso; y utilizar plataformas para superar la distancia entre artistas y oyentes, como en el caso de la empresa china Tencent, en la que los ingresos ya no están vinculados al stream, sino que se generan principalmente a través de enfoques basados en la participación de fondos de inversión." Otro punto, quizá no tan agradable, es que los servicios de streaming de Tencent Music albergan ahora más de 1.000 canciones con voces generadas por IA creadas por la empresa china, ¡y todas estas pistas acumulan ya no millones, sino miles de millones de reproducciones! ¿Se aprovecharán demasiado los servicios de streaming de sus posiciones ventajosas, hasta el punto de destronar a las grandes discográficas?

"Puedes decir que soy un soñador..."

¿O podemos imaginar un futuro próximo en el que el sector musical no dependa únicamente de las plataformas de streaming? Es cierto que estas empresas disponen de grandes cantidades de datos, compuestos por millones de datos sobre el comportamiento de los usuarios, y cuantos más datos se tienen, mejor funcionan los sistemas inteligentes que hay detrás de las plataformas más populares. Pero, ¿es posible prever que dentro de cinco o diez años pueda haber proyectos alternativos de pequeñas empresas, grupos musicales o profesionales individuales que también ofrezcan música por otras vías?

Con esto en mente, Jordi Pons, investigador de Dolby Laboratories, explica que un objetivo futuro podría ser crear un flujo de trabajo fácil que los artistas independientes pudieran utilizar para crear nuevo material con IA sin tener que invertir tiempo en aprender cómo funcionan estas herramientas. Según el director de investigación de la plataforma PANDORA, los grandes cambios no vendrán de las grandes compañías. "Hasta ahora tenemos innumerables ejemplos: BMAT, que empezó como una start-up y ha trastocado por completo la industria musical en los últimos 15 años; Moises, que utiliza técnicas de separación de audio con IA para eliminar o aislar voces e instrumentos, ajustar la velocidad y el tono, y habilitar el metrónomo en cualquier canción; y VoctroLabs, fundada en 2011 por cuatro expertos en música que ha hecho cosas increíbles y fue comprada por Voicemod, una empresa de voz aumentada con IA en diciembre del año pasado", explica Fabien Gouyon.

Gonçal Calvo, de BMAT, señala que "nadie está libre de la disrupción en este camino de la tecnología tan rápido en el que vivimos. Si desaparecen los derechos de autor, BMAT dejará de tener sentido. O nos reinventamos entendiendo lo que el mercado necesita, o vendrá otro", afirma Calvo. "La tecnología ha impactado en el sector musical. Recuerda cómo escuchaban música sus padres cuando era niño y piensa cómo lo harán sus hijos".

"Salvando las distancias"

Otro sueño para los próximos años es mejorar las conexiones entre artistas y oyentes. ¿Cómo puede lograrse? ¿Qué estrategias existen ya en la industria musical que podrían ver la luz en un futuro próximo? "Lo más importante es la forma con la que pueden interactuar. La gran empresa china Tencent está pasando de un modelo de ingresos basado en flujos a otro basado en fondos", explica Valerio Velardo. "Esto permite a los artistas reunirse con los oyentes en determinados momentos para cobrar. Por ejemplo, cuando un artista se reúne con fans, o cuando el público canta en un karaoke, etc. Mediante este modelo, que se basa en la idea de convertir en simbólica la relación entre artistas y oyentes, pueden ganarse la vida de forma justa. Todavía no lo hemos explorado en Occidente, pero la disrupción del negocio viene del mercado chino. Porque el verdadero valor de la música está en estas experiencias únicas".

Las redes que ponen en contacto a artistas y aficionados no son un concepto totalmente nuevo. Hace un par de décadas, Last.fm, un sitio web de música fundado en el Reino Unido en 2002, utilizaba un sistema de recomendación de música para construir un perfil detallado de los gustos musicales de cada usuario mediante el registro de los detalles de las canciones que el usuario escuchaba, ya sea de emisoras de radio por Internet, o del ordenador del usuario o de muchos dispositivos de música portátiles. Esta información se transfería (a través de un sistema para grabar las preferencias musicales de cada usuario para hacerle recomendaciones similares) a la base de datos de Last.fm a través del reproductor de música (incluidos, entre otros, Spotify, Deezer, Tidal, MusicBee, SoundCloud y Anghami) o a través de un plug-in instalado en el reproductor de música del usuario. Los datos se mostraban en la página del perfil del usuario y se compilaban para crear páginas de referencia de artistas individuales. Anteriormente, el sitio ofrecía un servicio de streaming de radio, que dejó de funcionar en 2014.

"La disrupción comercial viene ahora del mercado chino. El valor real de la música reside en estas experiencias únicas".

¿Puede la tecnología actual mejorar lo que Last.fm podía ofrecer entonces? "Con la tecnología que se ha desarrollado en los últimos 20 o 25 años, tenemos oportunidades que antes no teníamos", opina Valero. "Y no me refiero sólo a la música con IA. Hay miles de artistas que han descubierto Bandcamp, esta comunidad musical de tiendas de discos online que te da oportunidades que yo nunca tuve de niño". Y como afirma el director de investigación de PANDORA, Fabien Gouyon, "la gente seguirá yendo físicamente a un concierto, y recomendará música a sus amigos sin acudir a un ordenador. Los programas de recomendación no lo sustituirán todo".

Lista de deseos para el futuro

Si hiciéramos una lista con lo imprescindible para los próximos años en cuanto a creatividad musical y escucha de música, ¿qué habría en ella? ¿Y qué querríamos evitar? "Me gustaría que aparecieran nuevos géneros musicales, nuevos sonidos, nuevos bailes, diferentes instrumentos, diferentes formas de interpretar", dice la comisaria Antonia Folguera. "No me gustaría que las plataformas de streaming lanzaran música barata generada por inteligencia artificial", añade el artista Rob Clouth.

"Me gustaría ver sistemas más personalizados, experiencias únicas para cada oyente humano y no humano, música que no esté influenciada por los humanos. En cuanto a posibles temores... la producción de música aburrida, toda producida con las mismas herramientas, la homogeneización de la música occidental. Y que los sistemas se conviertan en "cajas negras". Cuando se vuelven cada vez más complejos, no hay transparencia, y es importante ver lo que hay entre bastidores", reflexiona la investigadora Anna Xambó.

"Hoy en día tenemos en nuestras manos herramientas para democratizar el acceso, dar voz a todo el mundo y hacer posible ganar dinero de formas que hoy son imposibles. Hay sitio para todos, tenemos que invertir en la idea de que ocurrirán grandes cosas. Hay que tener coraje y conocer las herramientas necesarias para avanzar", concluye el abogado Marcelo Estrella.

Se abre un mundo de enormes posibilidades que la gente sabrá aprovechar. Se avecina una era de uso y disfrute individualizado y personalizado de la música. O imagínese la idea de música terapéutica basada en bio/neurofeedback. O música que rastrea y reacciona a nuestras emociones.

¿Qué es ser humano?

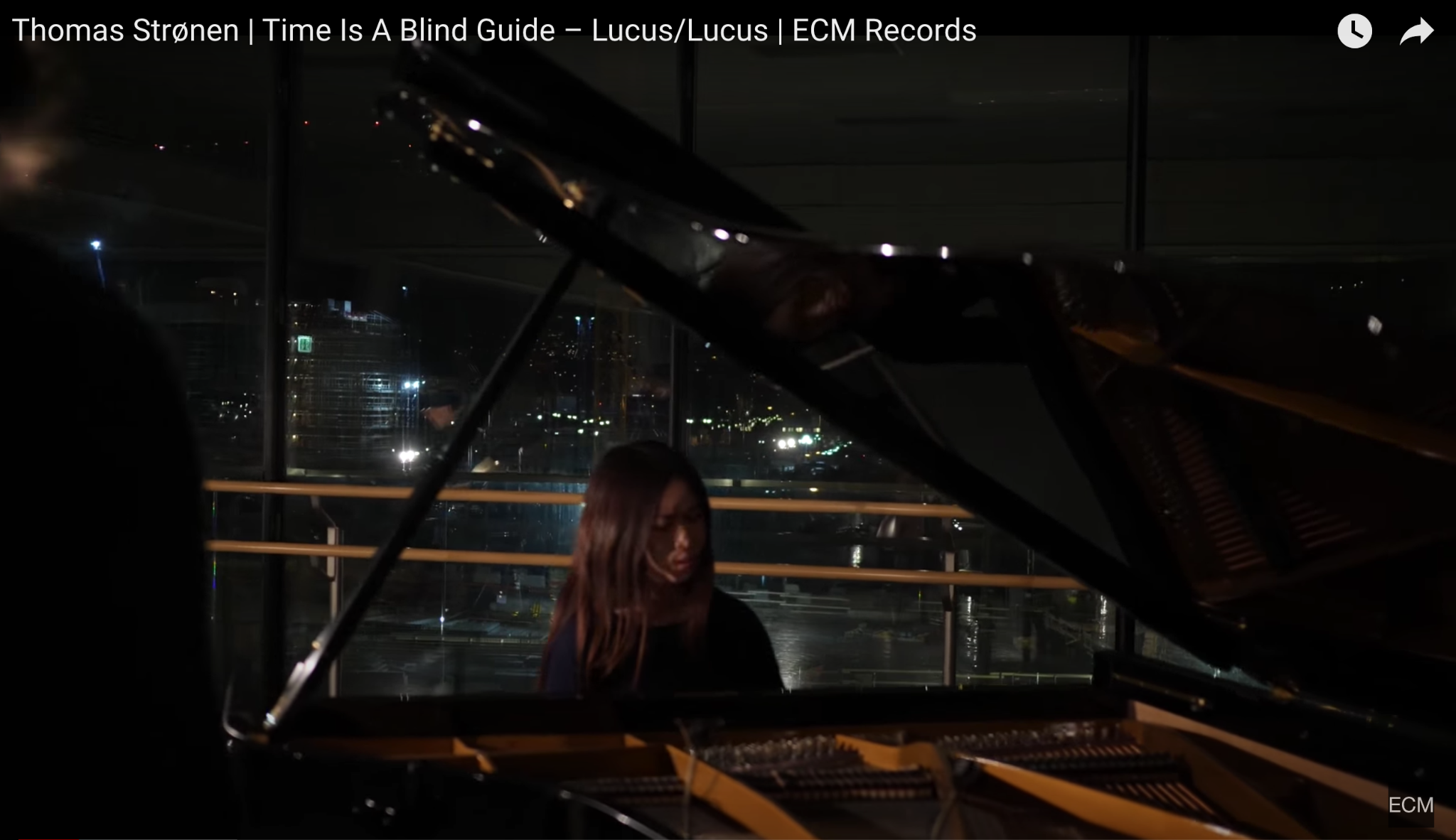

Finales de febrero de 2023. L’Auditori de Barcelona programa un concierto íntimo de música de jazz que podría clasificarse como música de cámara. Sobre el escenario, uno de los últimos proyectos del bateria noruego Thomas Strønen: 'Time is a blind guide'. Su banda -el violinista Håkon Aase, Leo Svensson Sander al violonchelo y Ole Morten Vågan al contrabajo- está acompañada por la exquisita pianista japonesa Ayumi Tanaka. Es una hora de pura improvisación, donde la música fluye en perfecta conexión entre los músicos y el público. Las composiciones son sólo una guía. El lenguaje visual de mirarse a los ojos es suficiente para que los músicos sepan cómo hacer evolucionar los temas y cuándo dejar de tocar. Antes de terminar el concierto, el líder del grupo pide a un músico turco que suba al escenario, y éste toca una delicada flauta con reminiscencias íntimas. La mezcla de culturas, sensibilidades y proezas artísticas hace que este concierto sea especialmente singular: "Tengo la suerte de estar rodeado de seres humanos increíbles y artistas fantásticos", dice Strønen al final, y el público aplaude en agradecimiento por un encuentro excepcional.

Tómese un momento para reflexionar sobre lo que significa la música para la humanidad. Además de disfrute y conexión con los demás -y como fuente de ingresos para la industria y los músicos profesionales-, tiene un enorme significado cultural en términos de historia, tradiciones, espiritualidad y prácticas religiosas. "La música es universal, se transmite de generación en generación, suele interpretarse en presencia de otros y tiene una antigüedad extrema", afirman los autores del artículo científico: "Perspectivas transculturales sobre la música y la musicalidad". ¿Tendrán también la IA y las tecnologías emergentes este poder de hacernos sentir que pertenecemos a un grupo social o que estamos separados de él?

En todas partes se cree que la música afecta a nuestras emociones, que implica algún tipo de excitación, "que va desde un leve placer o desagrado hasta estados de conciencia profundamente transformados", afirma el artículo científico. ¿Podrá la inteligencia artificial despertar estos sentimientos, estimular los sentidos y hacernos sentir asombro y conexión de la misma manera? Si es así, ¿diluye o incluso elimina algo que nos hace humanos? ¿Sigue siendo pertinente esta pregunta en un mundo globalizado en el que la tecnología está ya tan arraigada?

Seguimos flotando en las nubes, con pocas pistas sobre dónde acabaremos. Hay muchas preguntas sin respuesta, pero lo que sí sabemos es podemos encontrarnos con turbulencias.

Metodología: ¿Cómo hemos llegado hasta aquí?

Este artículo resume las principales conclusiones del proyecto Challenges and Opportunities in Music Tech liderado por el MTG. Es sólo un comienzo, una forma de organizar el debate actual sobre cómo la IA y las nuevas tecnologías cambiarán el sector de la música en los próximos años. El objetivo del proyecto era escuchar, recoger las opiniones de los principales interesados y compartirlas.

El equipo pasó cuatro meses entrevistando a ejecutivos de la industria, creadores musicales, oyentes, estudiantes de música, archiveros y desarrolladores. "Queríamos contribuir a la industria organizando estos debates", afirma el director del MTG, Xavier Serra.

El equipo partió de un cuestionario e intentó dividir los temas de interés en cuatro áreas: "Creación musical", "Audición musical y público", "Educación musical" y "Archivos musicales". La primera fase consistió en recoger respuestas de más de 80 expertos internacionales y locales del sector musical.

La segunda fase consistió en seleccionar a diez expertos para que analizaran estos temas en profundidad con creadores musicales, investigadores, desarrolladores musicales, profesores, comisarios musicales y artistas en una serie de 10 entrevistas de más de una hora de duración cada una.

El último paso era organizar un acto abierto y presencial con el público. Para diseñar cómo debía ser esta reunión, el equipo tuvo que cotejar el trabajo ya realizado (conclusiones de las encuestas y las entrevistas) y sopesar cómo resumir los principales temas de debate. Estaba claro que el tema principal sería la inteligencia artificial, pero el MTG también quería aportar opiniones que a veces no están representadas en los medios de comunicación generalistas. "Al mismo tiempo, nuestra intención era representar el mayor número posible de voces diferentes, porque este debate no puede centrarse sólo en un ámbito, ya sea el académico, el industrial o el político. Tiene implicaciones para todos. Por eso es necesario que todos participen en la discusión", afirma Serra.

Al tener acceso tanto a los conocimientos como a los últimos avances tecnológicos, el MTG tenía que asegurarse de que todos escucharan las opiniones de los demás. Así, en dos paneles de debate ("Creación musical" y "Escucha musical"), ocho representantes del sector musical compartieron sus puntos de vista sobre las ventajas, oportunidades, riesgos, temores y cuestiones éticas, en un debate que duró cuatro horas.

"Los oyentes -a los que no se suele escuchar ni tener en cuenta, pero que son cruciales porque son los que compran y consumen música y van a los conciertos- también deben estar representados en nuestro proyecto. También queríamos que la gente que no forma parte de las compañías pudiera dar su opinión", añade Xavier Serra.

El debate en todos los ámbitos y con todas las partes interesadas no ha hecho más que empezar. El siguiente paso para el MTG es aprender de los resultados de este debate para definir sus prioridades de investigación. Existen oportunidades enormes para desarrollar nuevas y mejores tecnologías de IA que acompañen a todas las partes interesadas en la música. Sin embargo, de las opiniones planteadas se desprende claramente que estas tecnologías deben dar prioridad a las preocupaciones éticas y ser transparentes ante la sociedad.

Un agradecimiento especial a los profesionales que han contribuido al proyecto participando en entrevistas en profundidad y como panelistas en el debate abierto:

- Malcolm Bain: abogado (Across Legal)

- Gonçal Calvo: director de Innovación (BMAT)

- Oscar Celma: director de Ingeniería (Spotify)

- Rob Clouth: creador de música

- Marcelo Estrella: abogado, a través de Legal

- Antonia Folguera: comisaria (Festival Sónar)

- Cristina Fuertes: profesora de Música (Institut Obert de Catalunya -IOC-)

- Emilia Gómez: investigadora principal (Centro Común de Investigación -Comisión Europea).

- Fabien Gouyon: director de Investigación (Pandora)

- Rujing Huang: etnomusicólogo y músico (Universidad de Hong Kong)

- Luca Andrea Ludovico: investigador (Laboratorio de Informática Musical de la Universidad de Milán)

- Jordi Pons: investigador (Dolby)

- Jordi Puy: director general (Derechos de Unison).

- Raúl Refree: creador y productor musical

- Robert Rich: creador y productor musical

- Valerio Velardo: consultor sobre IA y música

- Anna Xambó: investigadora y creadora musical (Instituto de Creatividad Sonora-Universidad DeMontfort)

Y también gracias a todos los que han participado en la encuesta de opinión.

El Music Technology Group (MTG)

El Music Technology Group (MTG) de la Universidad Pompeu Fabra de Barcelona cuenta con una amplia experiencia en la realización de proyectos de investigación con impacto en la sociedad. Creado en 1994, el grupo de investigación cuenta con más de 30 miembros que trabajan en diferentes temas relacionados con las tecnologías aplicadas a la creación, comprensión, consumo, educación y bienestar musical. Algunos de los productos más populares surgidos de los proyectos del grupo de investigación son: Reactable (instrumento digital interactivo), Vocaloid (sintetizador de voz cantante) o Freesound (plataforma de intercambio de sonidos).

En concreto, el grupo cuenta con una amplia experiencia en investigación y desarrollo de sistemas de recomendación, y ha estudiado el impacto de la tecnología musical en la diversidad cultural y de género, publicando artículos científicos sobre estos temas. El hecho de que el MTG sea un grupo de investigación en la intersección de los sectores de la música y la tecnología, facilita que el grupo pueda fomentar este diálogo equilibrado entre los diferentes agentes, y además, gracias a sus casi 30 años de trabajo activo, tiene una gran influencia en la comunidad científica y la capacidad de lograr un impacto relevante en el futuro desarrollo de la IA.

El proyecto Challenges and Opportunities in music tech ha sido dirigido por los investigadores Xavier Serra, Sergi Jordà, Dmitry Bogdanov, Frederic Font Corbera, Marius Miron, Perfecto Herrera, Sònia Espí y Lonce Wyse.

* Karma Peiró es colaboradora externa del MTG. Está especializada en Tecnologías de la Información y la Comunicación (TIC) desde 1995 y es coautora del Informe "Inteligencia Artificial. Decisiones automatizadas en Cataluña", de la Autoridad Catalana de Protección de Datos. Es ponente en seminarios y debates relacionados con el periodismo de datos, la ética de la inteligencia artificial, la transparencia informativa, los datos abiertos y la comunicación digital.

Este proyecto cuenta con el apoyo de la iniciativa MusicAIRE (financiada por la Unión Europea en el marco del programa Music Moves Europe) y del Ayuntamiento de Barcelona.